S.Labs

95% dos incidentes de segurança ocorrem devido a erro humano. Este é o chavão e o mote para este artigo ao qual dedico maior enfoque na engenharia social - o termo de referência para a ampla gama de atividades maliciosas realizadas por meio de interações humanas, para induzir os utilizadores a cometer erros de segurança ou a fornecer informações confidenciais que venham ser utilizado de forma maliciosa.

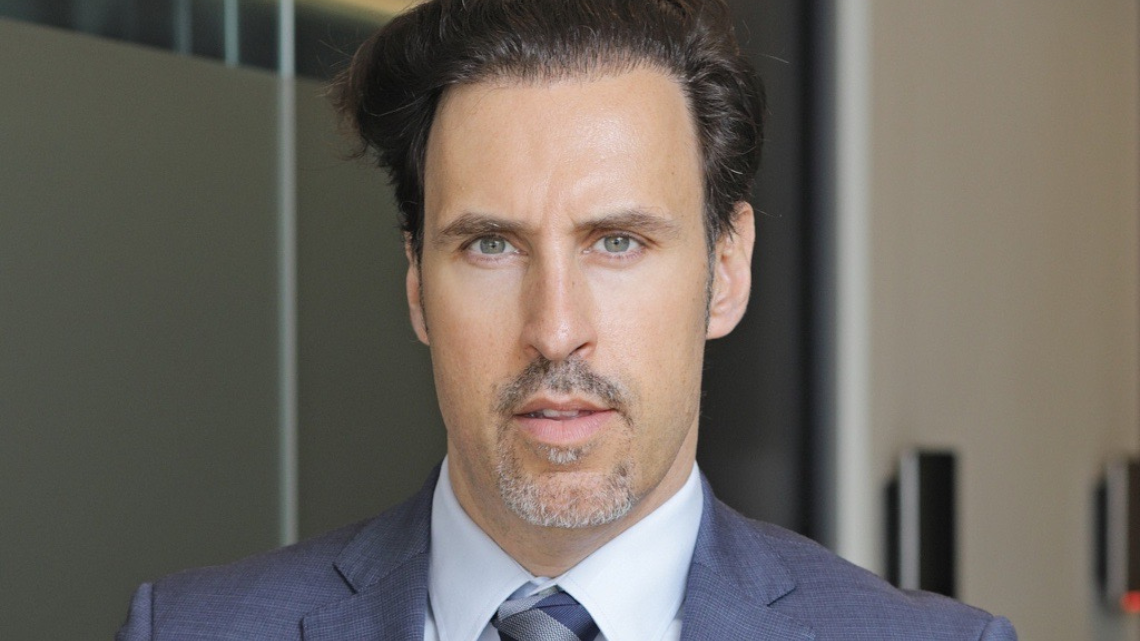

Por Bruno Castro, Fundador & CEO da VisionWare. Especialista em Cibersegurança e Análise Forense . 05/04/2024

|

Na era digital, em que as organizações se debatem para proteger a sua presença no ciberespaço, os seus dados confidenciais, antecipar a evolução de ameaças e mitigar constantemente os riscos para o seu negócio, é importante ter uma visão introspetiva. Os humanos continuam a ser a primeira força de defesa de uma organização e a primeira muitas vezes a ser explorada. O fator humano ainda continua a ser o elo mais fraco da cibersegurança. Para além do investimento em tecnologia, modelos de controlo, compliance e políticas normativas, é fundamental manter o nosso espírito critico aguçado para a inovação que está constantemente a desafiar a nossa zona de conforto. Hoje, mais do que nunca, é necessário colocar-nos a nós mesmo a questão se, para além da engenharia funcional, estamos preparados para a engenharia social. Num exército temos várias frentes ou divisões, cada uma com a sua função específica, mas todas juntas constituem um todo na estrutura de defesa. Também uma organização para se defender do cibercrime, independentemente das ameaças, tem de construir a sua defesa assente várias frentes, e a componente “humana” é logo a primeira em equação e certamente será tendencionalmente a mais importante face à ameaça dos ataques baseados em engenharia social. Então, mas já não sabemos que não podemos clicar no link de um email duvidoso e mal escrito? Sim, claro que sabemos. Contudo, a realidade é que a capacidade de inovação aplicada às técnicas de engenharia social está a evoluir exponencialmente, nomeadamente, com recurso à inteligência artificial generativa, tornando-as muito mais indetetáveis, impactantes e perigosas. Vamos desde já refletir sobre três exemplos bastante concretos: Primeiro, os ataques de phishing e principalmente de spear phishing, tornaram-se muito mais sofisticados, eficazes e complexos. Os típicos erros gramaticais que automaticamente sinalizam o perigo iminente deixaram de existir. Um colaborador de uma empresa que receba um email de phishing terá de ter a sua atenção redobrada, uma vez que, com ferramentas como o ChatGPT, os cibercriminosos podem criar campanhas de phishing em qualquer idioma, e utilizar a gramática e as nuances culturais corretas de forma a dar uma credibilidade reforçada a quem recebe a comunicação. Também ao nível do spear phishing, a IA generativa terá um grande impacto na medida em que potencia campanhas de phishing personalizadas, com conteúdo construído dinâmica face ao perfil da vítima o que vem aumentar significativamente a sua taxa de sucesso do ciberataque. Segundo, os ciberataques tornam-se mais automatizados. Através de agentes autónomos bem como de scripts inteligentes e outras ferramentas de automação, o cibercrime pode criar e realizar ciberataques de engenharia social altamente direcionados com um elevado nível de automação que garante envio massivos de ciberataques, mas com uma personalização dinâmica de acordo com a vítima em específico. Veio dar volume a ciberataques que anteriormente eram “manuais” e de baixo volume. Também as próprias fases do ataque podem ser automatizadas – desde a identificação do alvo até à entrega da comunicação maliciosa. Terceiro, os deepfakes de imagem e áudio, criados sinteticamente através de IA generativa são dos vetores de ameaças de engenharia social mais sérios e que representam uma das tendências mais inovadoras e perigosas do cibercrime. Os cibercriminosos já começaram a transformar deepfakes em armas de ciberataque a organizações ao ludibriar sistemas biométricos e de reconhecimento facial, e ainda ao imitar personalidades reais (como um executivo, um cliente, ou um parceiro da organização). Um exemplo de crime deepfake inclui a criação de mensagens de áudio falsas de CEO’s ou outros executivos de uma organização, através de plataformas aplicacionais de alteração de voz. Essas mensagens de áudio, geralmente manipuladas, contêm solicitações urgentes para que o destinatário realize transações financeiras ou revele informações confidenciais sem sequer questionar visto que se trata de uma variável – voz – que em teoria não poderia ser manipulado e, portanto, assume-se de elevada credibilidade. Seremos diariamente obrigados a estabelecer cada vez melhores e mais eficazes medidas de segurança aos nossos colaboradores, até porque, a tendência de exploração do fator humano para alcançar o negócio é uma realidade em franco crescimento. A ameaça de ciberataques por engenharia social em todas as suas variantes – as que já conhecemos e aquelas que iremos conhecer em breve - veio para ficar.

Conteúdo co-produzido pela MediaNext e pela VisionWare |